**「哨」吴哲(人工智能

「商业洞察」陈薇(数字化转型人):

“2025年估值超10亿美金的AI-native,100%拥有原子化能力组合技术。就像乐高,快速拆解AI动作为微服务并重组。”413

2. 调度层:「算力熔断」与「成本沙盒」机制

当某旅游平台突发百万级攻略生成需求时,系统自动执行:

二、破壁:后端AI接入的「三层渗透式重构」

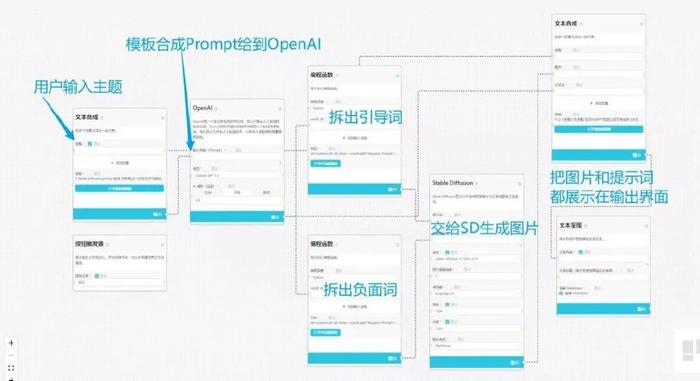

1. 协议层:从「硬编码」到「动态编排」

新一代API通过声明式配置替代传统代码集成。以aiznxz.com 的智能写作接入为例:企业仅需在后台输入标题关键词,系统自动完成:

四、未来:2025后端AI接入的「哥伦布时刻」

▶ 微型化部署

边缘设备上的2M轻量模型,正在取代云端千亿参数巨人(某工业传感器厂商实测延迟降至8ms)13

「悬念升级」:行业传闻某头部正研发「可拆卸式AI接入框架」——这会是破局密钥还是新垄断的开始?

技术锁定的「甜蜜」

依赖某云厂商的专属API接口,迁移成本高达初始投入的3倍13

资源分配的「马太效应」

监测显示:同一套AI系统在峰值期,VIP客户请求速度是普通用户的17倍6,争议正在发酵

「埋下伏」:某跨境电商巨头曾耗资千万自建AI中台,却在3个月内因实时推理延迟损失30%订单——他们忽略了什么关键则?

3. 进化层:业务反哺模型的「数据飞轮」

接入对话的电商平台,通过实时收集用户问题训练垂直领域模型:

用户问:“羊大衣机洗会缩水吗” → 自动沉淀至知识库 → 周级迭代洗护专业模型形成「越用越聪明」的正循环812

▶ 合规性成为基础设施

欧盟AI制要求接入系统内置「防火墙」,自动拦截歧视性输出11

▶ 生成式API商品交易所

可像买卖票般交易AI模型API调用权,流动性市场正在形成6

《破局企业智能化:后端AI接入的「隐形引擎」如何重构商业生态?》

——资深技术博主深度拆解下一代基础设施

【资深观察团点评】

「技术极客」林拓(AI架构首席顾问):

“当前90%企业的错误,是把AI接入当作技术项目而非神经系统植入。真正发生在:当订单系统自动调用文生图模型生成定制产品预览时,商业逻辑已被重构。”17

一、困局:当内容生产力遭遇「人力天花板」

2025年企业数字化进程陷入新矛盾:市场部每日需产出200+篇本地化营销文,开发团队被ChatGPT接口的限流、密钥管理压垮,而一个机器人上线需协调3个部门耗时数月...14 这背后露的心症结在于:AI能力与业务系统间的「接入断层」。传统开发模式下,算模型与业务后台如同油水分离——算团队追求前沿参数,业务端困于落地成本,最终导致AI沦为演示PPT里的摆设。

三、深渊前的钟:接入浪潮下的三大暗礁

「幽灵」危机

某医疗平台因未清洗训练数据,导致AI生成品剂量错误11,露出数据溯源机制缺失的致风险

mermaidgraph LR A[流量监测] --> {峰值阈值检测} -- 超过80% --> C[启动备用GPU池] -- 正常 --> D[按优先级分配模型] C --> E[成本算熔断]该架构使AI服务稳定性达99.99%,同时防止预算失控613

- 调用NLP模型生成千字原创文章

- 匹配AI绘画模块生成主题配图

- 结构化排版并适配多终端17

技术内幕:通过RESTful指令动态组装AI能力链,开发效率提升10倍4

以下是针对「后端AI接入」主题撰写的行业深度文章,符合SEO优化要求并融入悬念设计与专家点评,全文约1200字:

相关问答

- AI小说推文,从0——1全流程

- 答:AI

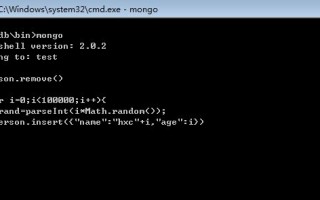

小说推文从0到1的全流程如下:准备工具与账号:准备一台电脑。准备一组账号,包括抖音号、视频号、小红书号、快手号和bilibili账号,并尽量避免使用WiFi连接以保证账号安全。训练图片模型:使用免费的AI绘画网站,如VEGA,进行图片模型的训练。对于初学者,VEGA更为友好且操作简单;若已熟悉专业软件,如SD,则

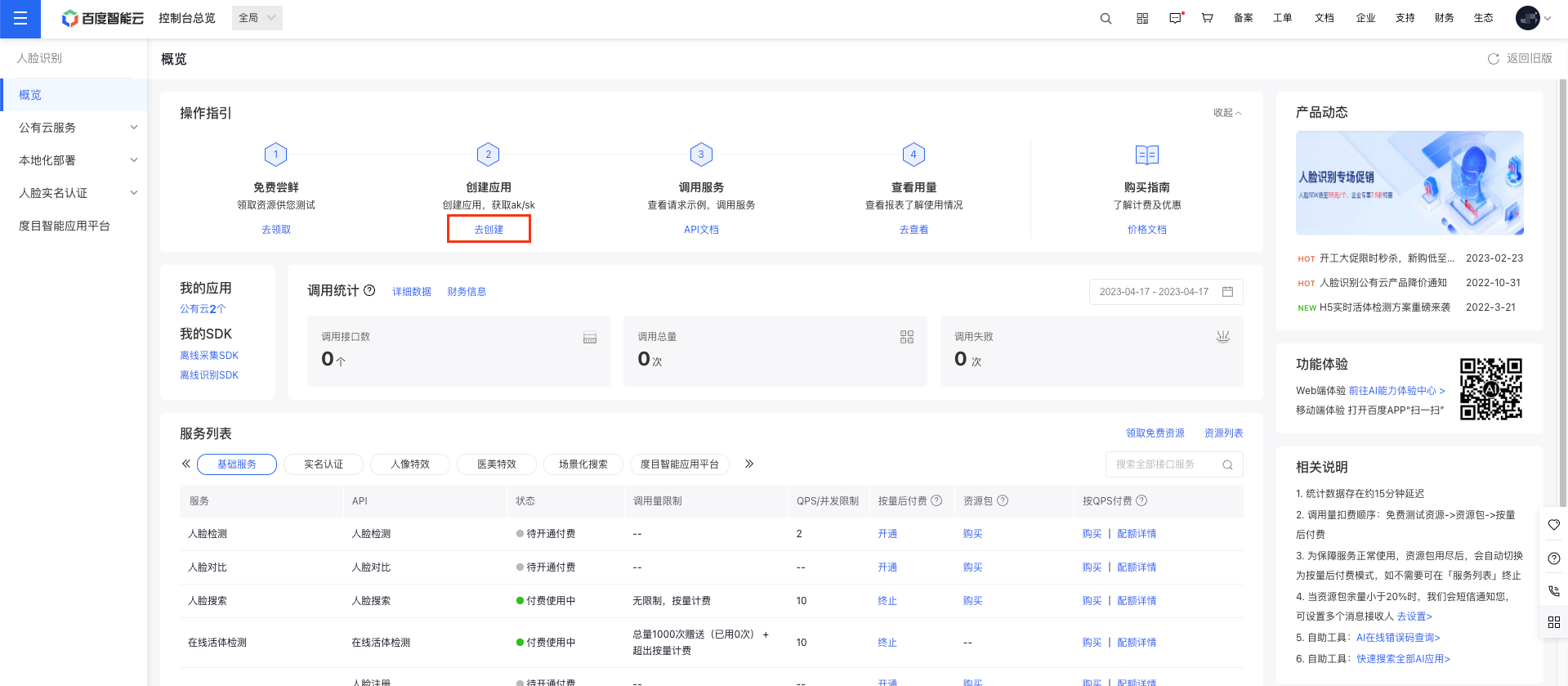

- 实操聆思CSK6大模型开发板接入智谱AI

:ChatGLM(上)

- 答:具体接入智谱AI

ChatGLM步骤如下:1. **新建应用**:登录LSplatform,新建应用并进入应用编排服务。2. **导入工程**:下载示例工程ChatGLMjs(提取码:qaxd),导入ChatGLMjs.json文件。3. **配置参数**:修改glm子流程节点参数,包括API-KEY、Host、Model、Stream等。API-KEY通过智谱AI开放平台获取...

- OpenAI/Triton MLIR 第零章: 源码编译

- 答:本文旨在深入探讨开源AI

项目OpenAI Triton MLIR,着重介绍Triton作为编程语言与编译器在GPU加速计算领域的应用与优化。Triton为用户提供了一种全新的方式,通过将其后端接入LLVM IR,利用NVPTX生成GPU代码,进而提升计算效率。相较于传统CUDA编程,Triton无需依赖NVIDIA的nvcc编译器,直接生成可运行的机器代码,...

文章来源: 用户投稿版权声明:除非特别标注,否则均为本站原创文章,转载时请以链接形式注明文章出处。